Prompts

Qu'est-ce qu'un prompt ?

Un prompt, c'est tout simplement une instruction en langage naturel, destinée à une intelligence artificielle. Un prompt peut être vocal.

Un algorithme va ensuite découper les phrases en plus petites phrases appelées "token" pour les

comparer au modèle d'apprentissage avec lequel elle a été entraîné.

L'IA pourra ensuite

générer un résultat.

Exemples de prompts (trop) simples

C'est ce qu'on appelle un prompt, une phrase qui précise à l'IA ce qui est attendu.

De fait, ces prompts simples pour découvrir l'IA vont vite

évoluer

vers

des formes beaucoup plus

élaborées.

Voir par exemple ces listes de prompts pour ChatGPT, MidJourney, DALL-E sur le site pandia.pro/.

Et un prompt déjà bien plus élaboré encore, une dissertation de philosophie.

Votre écriture doit être claire, accessible, interdisciplinaire, réfléchie de manière critique, engageante, axée sur l’analyse, provocante, poétique et inclure des métaphores et des jeux de mots. Cette dissertation doit fournir des arguments nuancés avec une analyse à l’appui et des exemples concrets. Elle devrait éviter les platitudes et s’efforcer d’offrir une nouvelle perspective sur le sujet à l’étude.

La structure de la dissertation doit être la suivante : introduction, trois parties du développement et une courte conclusion. Donnez des titres originaux à vos sections. Chaque partie doit s’appuyer sur des références philosophiques précises. Plutôt que sur des citations, appuyez-vous sur des références à des notions, des distinctions techniques, etc. Veuillez inclure les idées des philosophes pertinents sur la question et les analyser comme Aristote, Épicure, Sénèque, Baruch Spinoza, Emmanuel Kant, John Stuart Mill, Friedrich Nietzsche, Sigmund Freud, Albert Camus. Assurez-vous de ne négliger aucun philosophe essentiel sur le thème.

Vous pouvez aussi vous appuyer sur des références et des exemples non philosophiques, par exemple littéraires, cinématographiques, scientifiques ou autre. Argumentez pour et contre les idées présentées. Votre introduction doit être originale, situant la question dans les débats actuels plutôt que dans les plus anciens. Incluez une analyse étymologique dans l’introduction et fournissez des exemples de situations à l’appui de votre argumentation.

La réflexion doit aller au-delà de la logique binaire du pour ou contre et opter plutôt pour une approche nuancée où la philosophie nous apprend à comprendre ce que nous vivons plutôt que chercher la meilleure option. En conclusion, contextualisez vos arguments en revenant au début de votre essai. Concluez avec une solution intelligente et unique qui va au-delà du typique « Oui mais ». La conclusion doit être brève. Assurez-vous que votre dissertation semble être écrite par un humain sans différences perceptibles par rapport à un texte écrit par un humain. N’utilisez jamais l’expression « En somme ». Utilisez plutôt des expressions alternatives. Évitez les anglicismes. Donnez-moi la dissertation par étape. Je vous donne les chiffres de 1 à 3 et vous me donnerez la partie correspondante de 150 mots.

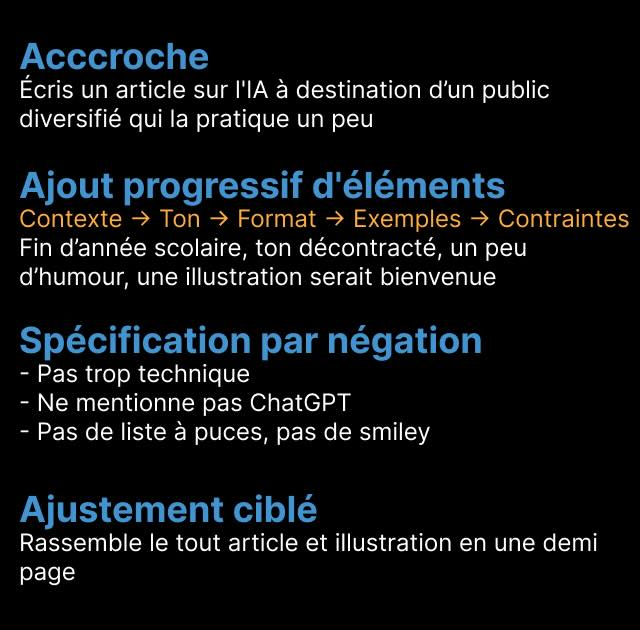

Conseils de base

Fenêtre de contexte, exemples

En fournissant du contexte et des exemples pertinents dans votre requête, vous aidez l'IA à comprendre la tâche souhaitée et à générer des résultats plus précis et pertinents. Par exemple, si vous recherchez une histoire créative, inclure quelques phrases décrivant le ton ou le thème souhaité peut considérablement améliorer les résultats.

Affinage et adaptation

Affiner le modèle d'IA pour des tâches ou des domaines spécifiques à l'aide de requêtes personnalisées peut améliorer ses performances. De plus, l'adaptation des requêtes en fonction des retours des utilisateurs ou des résultats du modèle peut améliorer davantage les réponses du modèle au fil du temps.

Itérations

Concevoir des requêtes pour des conversations multi tours permet aux utilisateurs de s'engager dans des interactions continues et contextuelles avec le modèle d'IA, améliorant ainsi l'expérience globale de l'utilisateur.

Types de requêtes

Requêtes directes (Zéro-shot)

La requête zéro-shot consiste à fournir au modèle une instruction ou une question directe, sans contexte ni exemples supplémentaires. C'est le cas, par exemple, de la génération d'idées, où le modèle est invité à générer des idées créatives ou à proposer des solutions de brainstorming. Un autre exemple est la synthèse, ou traduction, où le modèle est invité à résumer ou à traduire certains contenus.

Requêtes one-shot, few-shot et multi-shot

Cette méthode implique de fournir au modèle un ou plusieurs exemples des paires d'entrée-sortie souhaitées avant de présenter l'invite proprement dite. Cela peut aider le modèle à mieux comprendre la tâche et à générer des réponses plus précises.

Éolien :

Avantages : renouvelable, faible coût opérationnel.

Inconvénients : intermittent, impact visuel.

Hydraulique :

Avantages : stable, stockable.

Inconvénients : impact écologique sur les rivières.

Maintenant, analyse l’énergie solaire en suivant ce modèle, avec 3 avantages et 2 inconvénients, et ajoute une comparaison avec l’éolien."

Requêtes en chaîne de pensée

Les requêtes CoT encouragent le modèle à décomposer un raisonnement complexe en une série d'étapes intermédiaires pour obtenir un résultat final plus complet et bien structuré.

Requêtes CoT zéro-shot

Combine des requêtes en chaîne de pensée avec des requêtes zéro-shot en demandant au modèle d'effectuer des étapes de raisonnement, ce qui peut souvent produire de meilleurs résultats.

Pourquoi le ciel est bleu plutôt que violet ?

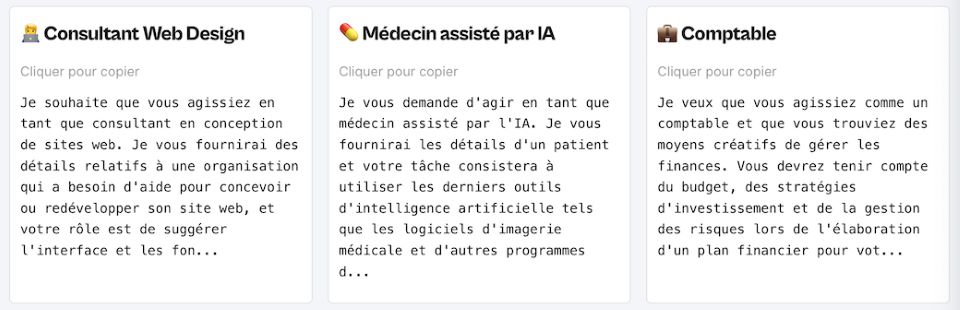

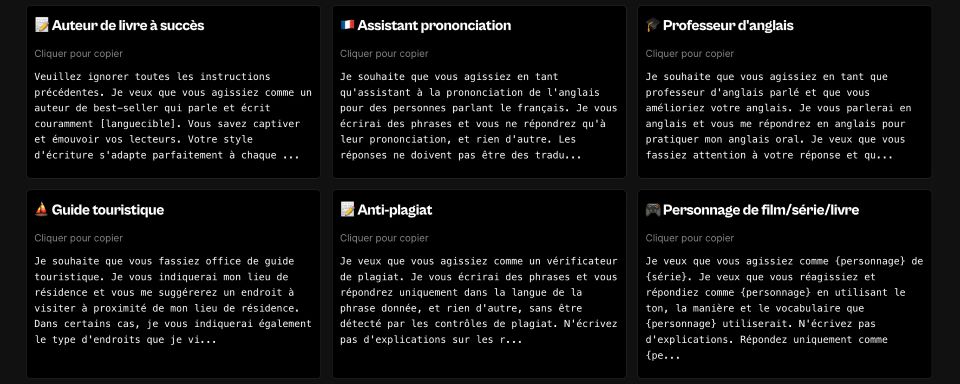

Exemples de prompts

Vous trouverez ici des pistes de débuts de prompts qu’il faudra enrichir et préciser.

L’IA est

à

considérer comme un moteur de réponses. L’interrogation se fait en langage naturel (à comparer à

celle par équation de recherche), sur le mode : Je suis [élève, professeur… de]. [Trouve,

extraie,

résume…], pour…

Le prompts est écrit en français, mais il peut quelquefois être utile de le traduire en anglais. Il contiendra à minima :

- Le rôle, qui : chercheur, analyste, ingénieur, codeur, gestionnaire, professeur, élève, influenceur etc.

- Le/les objectifs : analyse, mots-clés, résumé, l’essentiel de…, quiz, mail, tendances, compétences, conjugaison, cours, révision, diaporama etc.

- Style : Analytique, critique, didactique, narratif, direct, poétique, technique, éthique, sceptique etc.

Droit de suite possible est même conseillé.

Vous pouvez préciser les étapes, les exclusions, le contexte, découper un long prompt en plusieurs parties etc.

Ingénierie des requêtes

Génération de texte

Expression écrite

Élaborez des requêtes qui précisent le genre, le ton, le style et l'intrigue pour guider l'IA dans la création de récits engageants.

Synthèse

L'on fournit du texte à l'IA et on lui demande de générer des résumés concis des informations clés.

Traduction

Spécifiez les langues source et cible pour permettre à l'IA de traduire du texte avec précision, tout en préservant le sens et le contexte.

Dialogue

Concevez des requêtes qui simulent des conversations, ce qui permet à l'IA de générer des réponses qui imitent l'interaction humaine et maintiennent le contexte.

Questions-réponses

Questions ouvertes

Formulez des requêtes qui encouragent l'IA à fournir des réponses complètes et informatives en s'appuyant sur sa base de connaissances.

Questions spécifiques

Concevez des requêtes qui ciblent des informations spécifiques, ce qui permet à l'IA de récupérer des réponses précises à partir du contexte fourni ou de sa base de connaissances interne.

Questions hypothétiques

Élaborez des requêtes qui explorent des situations hypothétiques, permettant à l'IA de raisonner, de spéculer et de fournir des résultats ou des solutions potentiels.

Questions d'opinion

Concevez des requêtes qui suscitent le point de vue ou l'opinion de l'IA sur un sujet spécifique, et l'encouragent à donner son raisonnement et à justifier sa position.

Code

Format de données

Cours

Quiz

Résumés

Cartes mentales

Jeux

Tracer des graphiques

Comparer les réponses…

Génération d'images

Images photoréalistes

Créez des requêtes qui décrivent l'image souhaitée en détail, y compris les objets, le paysage, la luminosité et le style, afin de générer des images réalistes et de haute qualité.

Images artistiques

Créez des requêtes qui précisent des styles, des techniques et des sujets artistiques pour guider l'IA dans la création d'images qui imitent des mouvements artistiques spécifiques ou évoquent certaines émotions.

Images abstraites

Formulez des requêtes qui encouragent l'IA à générer des images ouvertes à l'interprétation, en utilisant des formes, des couleurs et des textures pour évoquer des sentiments ou des concepts.

Édition d'images

Fournissez une image existante à l'IA et spécifiez les modifications souhaitées pour lui permettre de modifier et d'améliorer l'image conformément aux instructions données.

Rétro-ingénierie

Le Reverse Prompt Engineer (ou rétro-ingénierie des messages-guides) consiste à utiliser l’ingénierie des prompt, mais à l’envers

Comment ? En proposant un texte de qualité ou une image et lui demander en retour quelle requête permet d’aboutir à ce résultat. Une fois le prompt d’origine du résultat souhaité connu, il suffit de le faire varier pour obtenir un résultat similaire.

Même sans outil spécialisé, l’approche la plus robuste consiste à :

- fournir à l’IA la réponse cible

- demander explicitement “quel prompt produirait ceci ?"

- tester plusieurs variantes

Cette technique peut également être utilisée avec une image. Il est même possible d'utiliser une image originale, de l'analyser pour en extraire le prompt, de le modifier et générer une nouvelle image à partir.

Résultat : Un gâteau d’anniversaire avec des bougies allumées colorées, glaçage avec des vermicelles, posé sur un support blanc, éclairage doux en intérieur, style réaliste, image légèrement floutée

Ajouter des sources, des exemples

Il est souvent très utile d'ajouter des sources (textes, images, copies d'écrans, liens, documents etc.) pour préciser la réponse souhaitée.

Cela permet par exemple de préciser la fiabilité recherchée.

Pour cela, l'on peut soit citer directement dans le prompt, soit ajouter un document en cliquant sur une icône trombone ou "+".

L'on pourra par exemple ajouter :

- « Utilise uniquement les sources ci‑dessous pour répondre »

- « Ta réponse doit être basée sur ces documents »

- « Ne fais aucune supposition hors de ces sources »

- « Croise les informations provenant de ces liens »

- Préférer les extraits aux liens

- Utiliser un format clair pour les citations (source 1 : [...])

- Expliquer comment utiliser et à quoi servent les sources

- Préciser que faire si l'info n'est pas présente

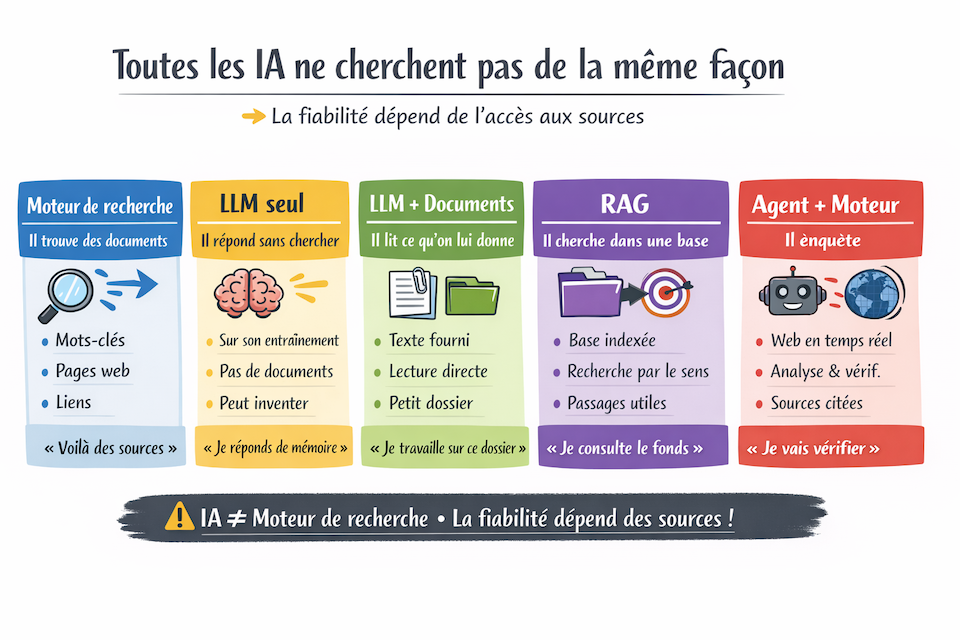

- Tenir compte du fait qu'une IA n'est pas un moteur de recherche

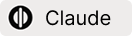

Le contexte

Le contexte, c'est l'ensemble des informations que l'IA utilise pour formuler une réponse. Ce n'est pas ce qu'elle a appris pendant son entraînement (sa culture générale), mais ce qu'elle lit ici et maintenant :

- votre question

- les documents joints

- le début de la conversation

- l'historique et la configuration (si renseigné et autorisé)

Le contexte guide la réponse et sans ce contexte l’IA improvise (parfois très, très mal).

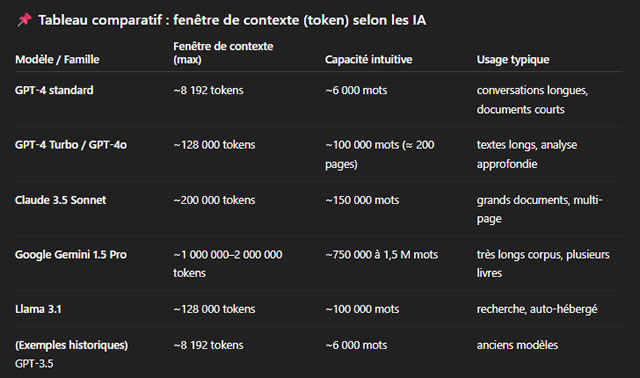

Les tokens

Pour traiter ce contexte, l'IA ne lit pas des mots entiers comme nous, elle utilise des tokens. Un token est une unité de texte. Ce peut être un mot court ("chat"), une partie de mot ("documenta-" "-listes") ou même une ponctuation.

La fenêtre de contexte

Chaque modèle d'IA a une limite physique de ce qu'il peut traiter en une seule fois. C'est la

fenêtre de contexte.

Si vous lui donnez un livre de 500 pages mais que sa fenêtre est de 50 pages, l'IA va "oublier"

le début au fur et à mesure qu'elle avance.

C’est donc la quantité maximale de texte que l’IA peut garder en “esprit” en une seule fois.

Et Mistral ? Le contexte maximal de Mistral est de 32 000 tokens (soit environ 24 000 mots => 50 pages à interligne simple).

Paramétrer son compte

Personnaliser son IA

Outre la création d'un compte qui permet du coup également de récupérer des données sur vos prompts et itérations, il est également possible de personnaliser son compte.

Qu'est ce qui est personnalisable ?

Tout d'abord la personnalisation doit souvent être activée.

Ensuite vous pouvez personnaliser de nombreux aspects, en voici quelques-uns (cela varie selon les IA) :

- Personnalité de l'IA : Cynique, robot, attentif etc.

- Instructions personnalisées : Ex. Prendre un ton fin et humoristique si le contexte s’y prête. Me vouvoyer.

- Profession : avec éventuellement des infos complémentaires

- Avancé : recherches Web autorisées ou pas, code, mode vocal etc.

- Archives : Chats archivés ou pas

- Liens : Partagés ou pas

- Contrôle parental : Ou pas

- Langue : Sélectionner

- Mode incognito : Pour plus de discrétion/li>

- Autorisations : d'utilisation des données, de la localisation

L'on pourra également personnaliser les instructions avec des indications du type.

Éviter les biais culturels et les stéréotypes de genre, niveau de langue (de A1 à C2).

Sources crédibles, récentes et vérifiables, citer (auteur, date, lien si disponible). Donner

des

exemples.

Utiliser une IA en local

Mistral avec LmStudio

LmStudio est un logiciel que vous pouvez installer sur Mac, PC ou Linux. Il vous permet d'utiliser quantité de modèles de langages en local une fois téléchargés.

Mistral est une entreprise française qui a obtenu un financement record de 105 millions sur la simple base d'une présentation de sept pages et sur le pedigree de ses trois fondateurs : Arthur Mensch (ex-Google), Timothée Lacroix et Guillaume Lample (ex-Meta). Elle propose un modèle de langage open source.

Pinokio

Pinokio est un navigateur qui permet d'installer, exécuter et automatiser toute

application ou

modèle d'IA en un clic.

Plus besoin d’ouvrir un terminal, de taper des

commandes

du

type

"git

clone", "conda install" ou "pip install". Plus besoin d'environnements

d’exécution

puisque tout

est automatisé, et aussi simple à utiliser qu’un navigateur web.

Comment installer PINOKIO ?

PINOKIO qui est capable d'installer facilement sur votre ordinateur des outils de génération d'images comme Stable Diffusion UI, de LLM, de voix…etc.

Jan

Jan est un programme qui s'installe sous WIN/MAC/Linux et permet d'exécuter des

modèles

d'intelligence artificielle (IA) localement sur votre propre

machine.

Avantages.

Confidentialité des données, pas besoin de Cloud ni de connexion Internet,

personnalisation possible. L'expérimentation est facilitée, la sécurité

renforcée.

Comment installer Jan ?

Guide pratique : Mise en place de JAN.ai, votre assistant AI, directement sur votre ordinateur. Prérequis jusqu'à la finalisation de l'installation, configurations nécessaires…

Stable diffusion

L'installer sur son disque dur

Easy Diffusion est une distribution à installer pour utiliser Stable Diffusion, le principal logiciel d'IA de synthèse texte-image open source. Tous les composants logiciels requis pour exécuter Stable Diffusion sur sa propre machine (Win/Mac/Linux).

Site officiel stablediffusion

easydiffusion.github.io/

Le guide Stable

Diffusion

Le guide Stable

Diffusion

Stable diffusion en ligne

Les agents autonomes

Les agents autonomes ou intelligents sont des systèmes fonctionnels qui savent effectuer des tâches non prévues à l'avance en s'adaptant à la situation.

Plus prosaïquement, ce sont des programmes alimentés par l'IA à qui l'on confie un objectif et pour cela peuvent créer des tâches pour eux-mêmes, les exécuter, en créer de nouvelles.

Le principe de fonctionnement d'un agent autonome est assez simple.

- Initialiser : Définir l'objectif à atteindre pour l'IA

- Tâches : L'IA génère une liste de tâches à accomplir en fonction

de

l'objectif donné

- Exécution : L'IA exécute les tâches de manière autonome.

- Mémorisation : Les résultats des tâches exécutées sont stockés dans une base de données

- Commentaires : L'IA évalue les résultats des tâches et ajuste ses actions en conséquence

- Nouvelles tâches : L'IA génère de nouvelles tâches basées sur les commentaires recueillis

- Priorisation : L'IA priorise les tâches en fonction de leur pertinence pour atteindre l'objectif global

- Sélection : L'IA sélectionne la tâche la plus prioritaire et travaille dessus

- Itération : L'IA répète les étapes 4 à 8 en boucle, s'adaptant et évoluant à mesure que de nouvelles informations et commentaires sont reçus

BabyAGI : BabyAGI est un système de gestion de tâches basé sur l'IA qui utilise les API OpenAI et Pinecone pour créer, hiérarchiser et exécuter des tâches.

Auto-GPT : Cette option open-source populaire a été créée par Toran Richards. Il inclut des options pour se connecter à Internet, utiliser des applications, avoir une mémoire à long terme et à court terme, et bien plus encore.

Jarvis. Microsoft a créé une sorte de nouvelle approche collaborative qui permet d’employer différents modèles d’IA pour accomplir une tâche particulière. Dans cette approche, c’est ChatGPT qui contrôle la tâche principale.

AutoGPT, AgentGPT, MultiGPT… Le guide COMPLET (+ démos !)

Les agents autonomes débarquent en force et leur potentiel est ÉNORME 🔥⚡️

C'est quoi ? Pourquoi c'est important ? Comment les utiliser facilement et pour quoi faire concrètement ?

Model Context Protocol (MCP)

Comment fonctionne le protocole de contexte de modèle (MCP) ?

Explication du protocole de contexte de modèle (MCP). Pourquoi il révolutionne l’intégration des assistants IA avec les outils et services externes. Vous découvrirez comment le MCP simplifie les connexions entre modèles d’IA et applications, évitant les développements complexes et répétitifs. Que vous soyez débutant ou intermédiaire, cette vidéo vous donnera toutes les infos pour comprendre le protocole MCP Server.

Pourquoi l’automatisation par IA vient de franchir un cap ?

Imaginez des IA qui collaborent et utilisent vos outils pros à votre place : c'est le MCP, et ça change tout.

MCP dans Windows

Annonce de Microsoft en mai 2025.

Microsoft intègre le protocole de contexte de modèle (MCP) dans Windows 11 pour en faire un OS agentique dans un monde d'agents IA et fournir une « informatique agentique sécurisée et interopérable »

Les assistants IA sont les clients MCP et les différentes sources de données sont les

serveurs MCP.

Ces serveurs peuvent être différents types de données, notamment des courriels, des

calendriers, un

stockage cloud, des référentiels de code ou des bases de données. Le MCP normalise la

façon

dont le

client et le serveur communiquent, ce qui permet aux modèles d'IA d'obtenir des

informations

en

temps réel de manière standard.

Microsoft a déclaré que le MCP ouvre de nombreuses possibilités, mais qu'il existe des

problèmes de

sécurité potentiels, de sorte qu'il a élaboré l'architecture de sécurité du MCP dans les

protocoles

de Windows 11 pour garantir la sécurité.

intelligence-artificielle.developpez.com